Chủ đề thịnh hành

Tin tức AI DePIN mới nhất

Xem các dự án AI

4 tháng trước

Google Ra Mắt Imagen 3: Một Kỷ Nguyên Mới Trong Tạo Hình Ảnh AI

Google đã chính thức ra mắt Imagen 3, mô hình AI chuyển đổi văn bản thành hình ảnh mới nhất của họ, năm tháng sau thông báo ban đầu tại Google I/O 2024. Phiên bản mới này hứa hẹn mang đến chất lượng hình ảnh được cải thiện với chi tiết tốt hơn, ánh sáng tốt hơn và ít hiện tượng hình ảnh không mong muốn hơn so với các phiên bản trước. Imagen 3 được thiết kế để diễn giải các yêu cầu bằng ngôn ngữ tự nhiên một cách chính xác hơn, cho phép người dùng tạo ra những hình ảnh cụ thể mà không cần phải lập trình yêu cầu phức tạp. Nó có thể sản xuất nhiều phong cách khác nhau, từ những bức ảnh siêu thực đến những minh họa vui nhộn, và thậm chí có thể hiển thị văn bản trong hình ảnh một cách rõ ràng, mở đường cho những ứng dụng sáng tạo như thiệp chúc mừng tùy chỉnh và tài liệu quảng cáo.

An toàn và sử dụng có trách nhiệm là ưu tiên hàng đầu trong sự phát triển của Imagen 3. Google DeepMind đã thực hiện các kỹ thuật lọc và gán nhãn dữ liệu nghiêm ngặt để giảm thiểu rủi ro tạo ra nội dung có hại hoặc không phù hợp. Cam kết đối với các tiêu chuẩn đạo đức là rất quan trọng khi công nghệ AI tạo sinh ngày càng được tích hợp vào nhiều ngành công nghiệp khác nhau. Người dùng quan tâm đến việc thử nghiệm Imagen 3 có thể làm như vậy thông qua Chatbot Gemini của Google bằng cách nhập các yêu cầu bằng ngôn ngữ tự nhiên, cho phép mô hình tạo ra những hình ảnh chi tiết dựa trên mô tả của họ.

Mặc dù có những tiến bộ, Imagen 3 vẫn có những hạn chế có thể ảnh hưởng đến khả năng sử dụng của nó đối với một số chuyên gia. Hiện tại, nó chỉ hỗ trợ tỷ lệ khung hình vuông, điều này có thể hạn chế các dự án yêu cầu định dạng phong cảnh hoặc chân dung. Thêm vào đó, nó thiếu các tính năng chỉnh sửa như inpainting hoặc outpainting, và người dùng không thể áp dụng các bộ lọc hoặc phong cách nghệ thuật cho hình ảnh của họ. Khi so sánh với các đối thủ như Midjourney, DALL-E 3 và Flux, Imagen 3 nổi bật về chất lượng hình ảnh và xử lý ngôn ngữ tự nhiên nhưng lại thiếu kiểm soát và tùy chỉnh cho người dùng. Tổng thể, mặc dù Imagen 3 là một công cụ mạnh mẽ để tạo ra hình ảnh chất lượng cao, nhưng những hạn chế của nó có thể làm nản lòng người dùng đang tìm kiếm nhiều sự linh hoạt hơn trong quy trình sáng tạo của họ.

4 tháng trước

Mạng Render Cách mạng hóa Sáng tạo Nội dung Kỹ thuật số với 'Unification'

Trong một cuộc thảo luận gần đây do Render Foundation Spaces tổ chức trên X, Jules Urbach, Giám đốc điều hành của OTOY và người sáng lập Mạng Render, đã cung cấp những hiểu biết về những thành tựu đột phá được tạo điều kiện bởi công nghệ hợp tác của họ trong quá trình sản xuất "765874 Unification," một bộ phim ngắn kỷ niệm 30 năm Star Trek. Urbach nhấn mạnh cách mà Mạng Render đang cách mạng hóa việc sáng tạo nội dung kỹ thuật số, cho phép các nhà sáng tạo khám phá những ranh giới mới trong điện ảnh, nghệ thuật và kể chuyện. Sản xuất bộ phim đã cho thấy tiềm năng của Mạng Render trong việc dân chủ hóa việc sáng tạo nội dung chất lượng cao, cho phép tạo ra hiệu ứng hình ảnh ấn tượng mà không cần ngân sách khổng lồ.

Một trong những điểm nổi bật của cuộc trò chuyện là việc sử dụng máy học (ML) một cách sáng tạo để nâng cao quy trình làm phim truyền thống. Urbach lưu ý rằng trong khi OTOY có một lịch sử dài trong việc sử dụng các bản sao kỹ thuật số và thay thế khuôn mặt, những tiến bộ trong công nghệ đã cho phép họ giảm đáng kể giờ lao động. Việc tích hợp AI đã đơn giản hóa việc mô hình hóa khuôn mặt của các diễn viên, loại bỏ sự cần thiết phải có các dấu hiệu khuôn mặt cồng kềnh. Điều này không chỉ rút ngắn quy trình sản xuất mà còn giúp các nghệ sĩ tập trung nhiều hơn vào việc kể chuyện thay vì những thách thức kỹ thuật, cho thấy cách mà AI và việc kết xuất GPU có thể biến đổi cảnh quan sáng tạo.

Nhìn về phía trước, Mạng Render dự kiến sẽ phát hành các công cụ và tích hợp mới, đặc biệt khi Ngày Thứ Sáu Đen đang đến gần. Kế hoạch bao gồm việc tích hợp các công cụ AI vào quy trình tạo hình 3D và mở rộng hỗ trợ cho việc kết xuất holographic. Tầm nhìn của Urbach vẫn rõ ràng: cung cấp cho các nhà sáng tạo những nguồn lực họ cần để kể những câu chuyện hấp dẫn. Thành công của "Unification" là một minh chứng cho tinh thần đổi mới của Mạng Render, mở đường cho các nhà sáng tạo tương lai vượt qua những ranh giới của những gì có thể trong việc sáng tạo nội dung kỹ thuật số.

4 tháng trước

Phòng Thí Nghiệm AI Hợp Tác với Theta EdgeCloud để Nâng Cao Giáo Dục AI

Phòng Thí Nghiệm AI, một nhà cung cấp e-learning hàng đầu tại Hàn Quốc, gần đây đã ký kết một thỏa thuận nhiều năm với Theta EdgeCloud, đánh dấu một bước quan trọng trong việc nâng cao các chương trình giáo dục về Trí Tuệ Nhân Tạo (AI) và Phân Tích Dữ Liệu (DA). Sự hợp tác này cho phép Phòng Thí Nghiệm AI tận dụng các nguồn tài nguyên GPU phân tán của Theta EdgeCloud, điều này sẽ hỗ trợ giáo dục AI tiên tiến, đào tạo mô hình và các ứng dụng AI sinh tạo. Với trọng tâm mạnh mẽ vào trải nghiệm thực hành và nội dung tương tác, Phòng Thí Nghiệm AI nhằm mục tiêu cung cấp giáo dục chất lượng cao thông qua nền tảng sáng tạo của mình, CodingX, được công nhận vì hiệu quả trong việc dạy AI và kỹ năng lập trình trên toàn cầu.

Sự hợp tác với Theta EdgeCloud dự kiến sẽ mang lại nhiều lợi ích cho Phòng Thí Nghiệm AI. Bằng cách sử dụng các nguồn GPU theo yêu cầu, tổ chức có thể nâng cao tính linh hoạt của chương trình giảng dạy, cho phép tích hợp liền mạch AI vào các chương trình giáo dục của mình. Thêm vào đó, sự hợp tác này sẽ giảm chi phí hoạt động thông qua cơ sở hạ tầng phân tán của Theta, cho phép mở rộng dịch vụ một cách tiết kiệm chi phí. Quan trọng nhất, việc tích hợp các phương pháp học tập dựa trên AI sẽ tạo điều kiện cho những trải nghiệm học tập cá nhân hóa, được điều chỉnh để đáp ứng nhu cầu độc đáo của từng sinh viên, từ đó cải thiện hiệu suất tổng thể.

Theta EdgeCloud đã nhanh chóng mở rộng cơ sở khách hàng của mình, gần đây đã hợp tác với các tổ chức danh tiếng như Đại học Quốc gia Seoul và Đại học Bắc Kinh. Sự tăng trưởng này nhấn mạnh nhu cầu ngày càng tăng về các giải pháp công nghệ có thể mở rộng và tiết kiệm chi phí trong lĩnh vực giáo dục. John Choi, Giám đốc điều hành của Phòng Thí Nghiệm AI, bày tỏ sự tự tin vào sự hợp tác này, nhấn mạnh danh tiếng mạnh mẽ của Theta trong các trường đại học Hàn Quốc và tiềm năng của nó để mở rộng đáng kể hoạt động của Phòng Thí Nghiệm AI trong những năm tới. Sự hợp tác này dự kiến sẽ đáp ứng nhu cầu ngày càng tăng về kỹ năng công nghệ trong một tương lai dựa trên AI, định vị Phòng Thí Nghiệm AI như một nhân tố chính trong bối cảnh giáo dục đang phát triển.

4 tháng trước

Tinh Chỉnh Llama 3.2 11B với Q-LoRA cho Câu Hỏi Trích Xuất

Các Mô Hình Ngôn Ngữ Lớn (LLMs) đã trở thành công cụ thiết yếu trong xử lý ngôn ngữ tự nhiên, có khả năng xử lý nhiều nhiệm vụ khác nhau. Tuy nhiên, do việc đào tạo rộng rãi của chúng, chúng có thể không xuất sắc trong các ứng dụng cụ thể mà không cần điều chỉnh thêm. Các kỹ thuật tinh chỉnh, chẳng hạn như Q-LoRA, cho phép các nhà nghiên cứu điều chỉnh các mô hình đã được đào tạo trước như Llama 3.2 11B cho các nhiệm vụ cụ thể, chẳng hạn như câu hỏi trích xuất. Bài viết này phác thảo quy trình tinh chỉnh Llama 3.2 11B sử dụng Q-LoRA trên tập dữ liệu SQuAD v2, trình bày những cải tiến về hiệu suất đạt được thông qua phương pháp này.

LoRA, hay Điều Chỉnh Thấp Hạng, là một kỹ thuật giới thiệu các trọng số mới vào một mô hình hiện có mà không thay đổi các tham số gốc. Bằng cách thêm các trọng số bộ điều chỉnh điều chỉnh đầu ra của một số lớp nhất định, LoRA cho phép các mô hình giữ lại kiến thức đã được đào tạo trước trong khi có được các khả năng mới được điều chỉnh cho các nhiệm vụ cụ thể. Trong thí nghiệm này, trọng tâm là tinh chỉnh Llama 3.2 11B cho câu hỏi trích xuất, nhằm mục đích trích xuất các đoạn văn bản chính xác trả lời trực tiếp các truy vấn của người dùng, thay vì tóm tắt hoặc diễn đạt lại nội dung. Thí nghiệm được thực hiện trên nền tảng Google Colab sử dụng GPU A100, với thư viện Hugging Face Transformers hỗ trợ việc triển khai.

Kết quả của quá trình tinh chỉnh rất hứa hẹn, cho thấy sự cải thiện đáng kể trong hiệu suất của mô hình trên tập xác thực. Điểm BERT cải thiện từ 0.6469 lên 0.7505, trong khi điểm khớp chính xác tăng từ 0.116 lên 0.418. Những cải tiến này cho thấy kỹ thuật Q-LoRA thích ứng hiệu quả mô hình Llama 3.2 11B cho các nhiệm vụ câu hỏi trích xuất. Bài viết này phục vụ như một hướng dẫn cho các nhà nghiên cứu muốn áp dụng các phương pháp tương tự cho các mô hình và nhiệm vụ khác, nhấn mạnh tiềm năng của việc tinh chỉnh trong lĩnh vực xử lý ngôn ngữ tự nhiên.

4 tháng trước

io.net hợp tác với OpenLedger để nâng cao phát triển mô hình AI

Tuần này, nền tảng tài nguyên GPU phân tán phi tập trung io.net đã công bố một quan hệ đối tác chiến lược với OpenLedger, một blockchain dữ liệu được thiết kế đặc biệt cho trí tuệ nhân tạo (AI). Sự hợp tác này sẽ cho phép OpenLedger sử dụng tài nguyên tính toán GPU toàn cầu của io.net, nâng cao khả năng tinh chỉnh và đào tạo các mô hình AI. Được biết đến như Internet của các GPU, io.net cung cấp một mạng lưới mạnh mẽ các tài nguyên GPU phân tán, cho phép OpenLedger tăng tốc phát triển các mô hình AI của mình và trao quyền cho các nhà phát triển tạo ra các ứng dụng phi tập trung (DApps) dựa trên AI hiệu quả hơn. Theo Tausif Ahmad, Phó Chủ tịch Phát triển Kinh doanh tại io.net, quan hệ đối tác này sẽ cung cấp cho OpenLedger một cơ sở hạ tầng đáng tin cậy để mở rộng các mô hình AI của mình và mở khóa các trường hợp sử dụng mới, củng cố vị thế của nó như một nhà cung cấp đổi mới trong không gian AI phi tập trung.

Ngoài việc cung cấp tài nguyên GPU, cơ sở hạ tầng của io.net sẽ hỗ trợ việc suy diễn và lưu trữ các mô hình AI, đảm bảo hiệu suất và khả năng mở rộng tối ưu. Quan hệ đối tác này dự kiến sẽ nâng cao danh tiếng của OpenLedger như một nhà cung cấp dữ liệu đáng tin cậy, thúc đẩy đổi mới tại giao điểm của blockchain và AI. Sự hợp tác nhằm tạo ra dữ liệu chất lượng cao một cách an toàn và hiệu quả trong khi thúc đẩy đổi mới và hiệu suất. Một thành viên trong nhóm của OpenLedger nhấn mạnh rằng việc tận dụng cơ sở hạ tầng GPU của io.net sẽ cho phép người dùng tinh chỉnh các mô hình AI một cách hiệu quả hơn, cuối cùng dẫn đến sự phát triển của các mô hình AI đáng tin cậy và có thể giải thích.

Một yếu tố quan trọng trong sự lựa chọn của OpenLedger đối với io.net như là nhà cung cấp tài nguyên GPU của mình là các giải pháp tính toán hiệu quả về chi phí và có thể mở rộng. Quan hệ đối tác này sẽ cho phép OpenLedger mở rộng dịch vụ của mình mà không bị ràng buộc bởi chi phí cao liên quan đến các nhà cung cấp đám mây tập trung. Bằng cách xử lý các tập dữ liệu lớn hơn và phát triển các mô hình AI với hiệu suất chưa từng có, OpenLedger nhằm mục đích đẩy ranh giới của đổi mới AI phi tập trung. Cuối cùng, quan hệ đối tác này phù hợp với sứ mệnh của OpenLedger trong việc thúc đẩy một môi trường dữ liệu mở và hợp tác trong khi thúc đẩy việc áp dụng các giải pháp AI được hỗ trợ bởi blockchain.

4 tháng trước

Stratos Hợp Tác với Cortensor để Nâng Cao Cơ Sở Hạ Tầng AI Phi Tập Trung

Trong một phát triển quan trọng cho lĩnh vực AI phi tập trung, Stratos đã công bố một quan hệ đối tác với Cortensor, một nhà lãnh đạo trong các mạng lưới suy diễn AI phi tập trung. Sự hợp tác này nhằm nâng cao cơ sở hạ tầng AI phi tập trung bằng cách tích hợp các giải pháp lưu trữ và phát trực tuyến phi tập trung mạnh mẽ của Stratos vào hệ sinh thái AI sáng tạo của Cortensor. Quan hệ đối tác này sẽ cung cấp lưu trữ dữ liệu an toàn và có thể mở rộng, đảm bảo rằng cả khối lượng công việc AI công khai và riêng tư đều có thể hoạt động liền mạch và đáng tin cậy, từ đó cải thiện hiệu suất mạng tổng thể.

Một trong những tính năng chính của sự hợp tác này là việc giới thiệu khả năng phát trực tuyến suy diễn thời gian thực. Các API phát video tiên tiến của Stratos sẽ cho phép Cortensor cung cấp đầu ra suy diễn AI ngay lập tức, tạo điều kiện cho các ứng dụng động và các nhiệm vụ do người dùng điều khiển. Sự cải tiến này dự kiến sẽ tối ưu hóa hiệu suất cho các khối lượng công việc AI, khi cơ sở hạ tầng thông lượng cao của Stratos sẽ cải thiện giao tiếp giữa các nút, đảm bảo dòng dữ liệu hiệu quả ngay cả trong các môi trường có nhu cầu cao. Đây là một bước quan trọng hướng tới việc làm cho các công cụ AI tiên tiến trở nên dễ tiếp cận và tiết kiệm chi phí hơn.

Cả hai công ty đều chia sẻ một tầm nhìn cho tương lai AI phi tập trung, với hệ thống Chứng minh Suy diễn (PoI) và Chứng minh Công việc Hữu ích (PoUW) của Cortensor xác thực các nhiệm vụ và thưởng cho những người đóng góp cho công việc có ý nghĩa. Stratos, với cơ sở hạ tầng phi tập trung hỗ trợ các giải pháp Web3 và AI, có hơn 900 nút lưu trữ toàn cầu hoạt động và dung lượng 21 PB. Quan hệ đối tác này không chỉ minh chứng cho cam kết của họ đối với đổi mới mà còn nhằm mở ra những khả năng mới cho các doanh nghiệp, nhà phát triển và thợ mỏ do cộng đồng điều hành, cuối cùng xây dựng một hệ sinh thái AI bao trùm và có thể mở rộng hơn. Hãy theo dõi các cập nhật tiếp theo khi họ tiếp tục đẩy mạnh ranh giới của các giải pháp AI phi tập trung.

4 tháng trước

Cải thiện khả năng nhớ ngữ cảnh trong Tạo ra Tăng cường Tìm kiếm

Tạo ra tăng cường tìm kiếm (RAG) đã nổi lên như một phương pháp quan trọng để tích hợp các mô hình ngôn ngữ lớn (LLMs) vào các ứng dụng kinh doanh chuyên biệt, cho phép tích hợp dữ liệu độc quyền vào các phản hồi của mô hình. Mặc dù hiệu quả trong giai đoạn thử nghiệm (POC), các nhà phát triển thường gặp phải sự sụt giảm độ chính xác đáng kể khi chuyển RAG vào sản xuất. Vấn đề này đặc biệt rõ ràng trong giai đoạn tìm kiếm, nơi mục tiêu là lấy chính xác ngữ cảnh liên quan nhất cho một truy vấn nhất định, một chỉ số được gọi là khả năng nhớ ngữ cảnh. Bài viết này đi sâu vào các chiến lược để cải thiện khả năng nhớ ngữ cảnh bằng cách tùy chỉnh và tinh chỉnh các mô hình nhúng, cuối cùng cải thiện hiệu suất của RAG trong các ứng dụng thực tế.

RAG hoạt động trong hai bước chính: tìm kiếm và tạo ra. Trong giai đoạn tìm kiếm, mô hình chuyển đổi văn bản thành các vector, lập chỉ mục, truy xuất và xếp hạng lại các vector này để xác định các kết quả hàng đầu. Tuy nhiên, các thất bại trong giai đoạn này có thể dẫn đến việc bỏ lỡ các ngữ cảnh liên quan, dẫn đến khả năng nhớ ngữ cảnh thấp hơn và các đầu ra tạo ra ít chính xác hơn. Một giải pháp hiệu quả là điều chỉnh mô hình nhúng, được thiết kế để hiểu mối quan hệ giữa dữ liệu văn bản, để tạo ra các nhúng cụ thể cho tập dữ liệu đang được sử dụng. Việc tinh chỉnh này cho phép mô hình tạo ra các vector tương tự cho các câu tương tự, nâng cao khả năng truy xuất ngữ cảnh rất liên quan đến truy vấn.

Để cải thiện khả năng nhớ ngữ cảnh, điều cần thiết là chuẩn bị một tập dữ liệu tùy chỉnh phản ánh các loại truy vấn mà mô hình sẽ gặp phải. Điều này bao gồm việc trích xuất một loạt các câu hỏi đa dạng từ cơ sở tri thức, diễn đạt lại chúng để tạo sự biến đổi, và tổ chức chúng theo mức độ liên quan. Ngoài ra, việc xây dựng một tập dữ liệu đánh giá giúp đánh giá hiệu suất của mô hình trong một môi trường thực tế. Bằng cách sử dụng một Đánh giá viên Tìm kiếm Thông tin, các nhà phát triển có thể đo lường các chỉ số như Recall@k và Precision@k để đánh giá độ chính xác của việc truy xuất. Cuối cùng, việc tinh chỉnh mô hình nhúng có thể dẫn đến những cải thiện đáng kể trong khả năng nhớ ngữ cảnh, đảm bảo rằng RAG vẫn chính xác và đáng tin cậy trong các môi trường sản xuất.

4 tháng trước

Cách mạng hóa Nông nghiệp với Công nghệ IoT

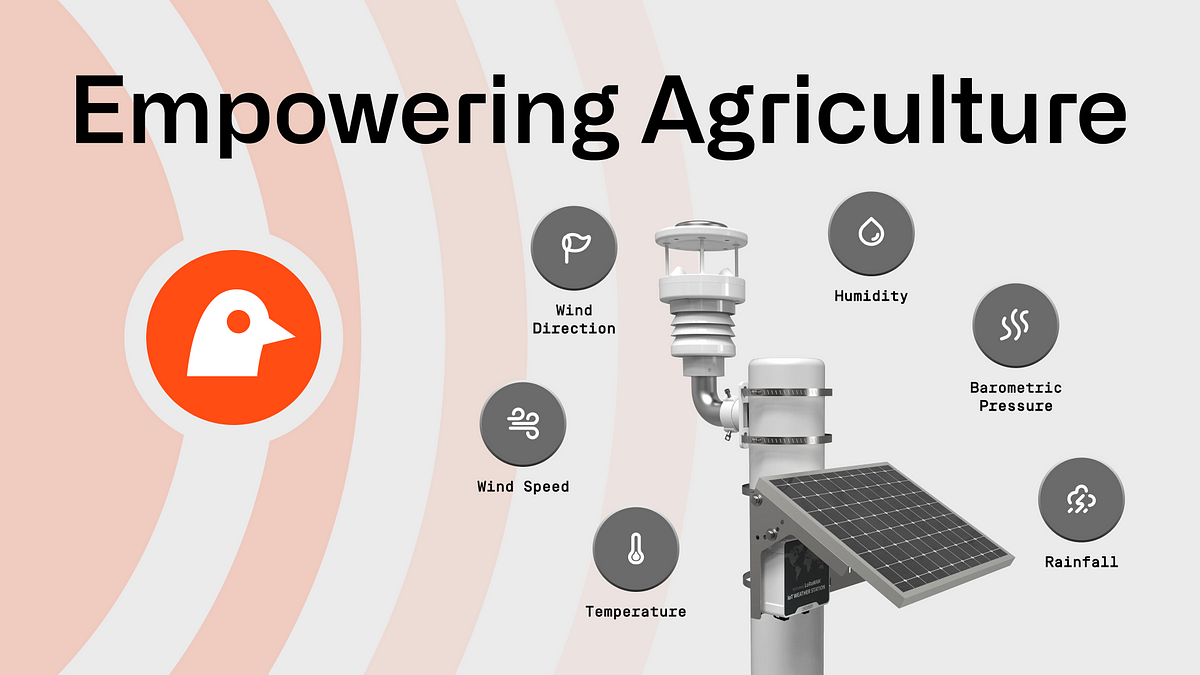

Việc tích hợp công nghệ IoT trong nông nghiệp đang chuyển đổi lĩnh vực này, cho phép nông dân đưa ra quyết định dựa trên dữ liệu, từ đó nâng cao năng suất và tính bền vững. Thị trường nông nghiệp thông minh toàn cầu dự kiến sẽ đạt 20 tỷ USD vào năm 2026, nhờ vào việc áp dụng ngày càng nhiều các giải pháp IoT trên các trang trại. Những công nghệ này tối ưu hóa nhiều khía cạnh của quản lý cây trồng và chăn nuôi, giúp nông dân giảm chi phí trong khi cải thiện năng suất và quản lý môi trường. Khi các thiết bị IoT ngày càng phổ biến, chúng mang lại những lợi thế đáng kể, bao gồm tự động hóa quản lý tài nguyên và thu thập dữ liệu theo thời gian thực về các yếu tố quan trọng như thời tiết và điều kiện đất đai.

Các thiết bị IoT như trạm thời tiết và cảm biến đất đóng vai trò quan trọng trong nông nghiệp thông minh. Trạm thời tiết cung cấp dữ liệu thiết yếu về nhiệt độ, độ ẩm và lượng mưa, cho phép nông dân điều chỉnh kịp thời lịch tưới và lịch trồng. Cảm biến đất cung cấp thông tin theo thời gian thực về mức độ độ ẩm, tối ưu hóa việc sử dụng nước và chiến lược bón phân. Thêm vào đó, cổ áo theo dõi gia súc đảm bảo quản lý chủ động về sức khỏe và vị trí của động vật. Bằng cách tự động hóa tưới tiêu và phân phối tài nguyên dựa trên dữ liệu theo thời gian thực, nông dân có thể tiết kiệm tài nguyên và cải thiện sức khỏe cây trồng, cuối cùng dẫn đến tăng lợi nhuận.

Nền tảng của Chirp nâng cao hiệu quả của các thiết bị IoT này bằng cách tích hợp chúng vào một hệ thống đồng bộ được quản lý từ một bảng điều khiển duy nhất. Việc tích hợp công nghệ blockchain càng củng cố quản lý dữ liệu, đảm bảo lưu trữ an toàn, không thể thay đổi và khả năng truy xuất nguồn gốc của lượng thông tin khổng lồ được tạo ra bởi các thiết bị IoT. Các thợ mỏ Blackbird của Chirp cung cấp kết nối khoảng cách xa cho các thiết bị này, tạo điều kiện cho việc truyền dữ liệu đáng tin cậy trên diện rộng mà không cần kết nối internet riêng lẻ. Sự tích hợp liền mạch của công nghệ IoT này định vị Chirp như một đối tác quan trọng cho nông dân, trao quyền cho họ để đối phó với những thách thức và tận dụng các cơ hội mới trong bối cảnh nông nghiệp đang phát triển.

4 tháng trước

VentureMind AI hợp tác với Theta EdgeCloud để nâng cao khả năng AI và Robotics

Trong một phát triển thú vị cho sự giao thoa giữa AI và blockchain, VentureMind AI đã thông báo một sự hợp tác với Theta EdgeCloud. Sự hợp tác này nhằm tận dụng tài nguyên tính toán và phát trực tuyến phi tập trung, độ trễ thấp của Theta để nâng cao khả năng của VentureMind AI. Bằng cách tích hợp EdgeCloud, VentureMind AI sẽ có thể mở rộng các công cụ AI của mình, tối ưu hóa việc xử lý video và cung cấp điều khiển robotics theo thời gian thực, cải thiện đáng kể các dịch vụ của mình trong các lĩnh vực như xây dựng và an ninh. Sự hợp tác này đánh dấu một bước quan trọng trong việc tạo ra một hệ sinh thái toàn diện kết hợp đổi mới AI với tài chính phi tập trung và robotics tiên tiến.

VentureMind AI là một nền tảng tiên phong cho phép người dùng tạo ra, đúc và giao dịch các công cụ AI dưới dạng NFT, cung cấp một lớp sở hữu và tiềm năng thu nhập độc đáo. Nền tảng này cũng có một công cụ xây dựng Đại lý Tự động tùy chỉnh, cho phép người dùng khởi chạy các cộng đồng được mã hóa và quản lý các hoạt động tạo lập thị trường. Kể từ khi ra mắt vào tháng 6 năm 2023, EdgeCloud đã thu hút được sự chú ý trong cả môi trường học thuật và doanh nghiệp, với các tổ chức như Đại học Quốc gia Seoul và các công ty như GenAI search Liner sử dụng cơ sở hạ tầng của nó để thúc đẩy nghiên cứu và ứng dụng AI.

Với sự tích hợp của Theta EdgeCloud, VentureMind AI đang sẵn sàng định nghĩa lại những khả năng trong các lĩnh vực AI, robotics và Web3. Sự hợp tác này sẽ tạo điều kiện cho tính toán có thể mở rộng cho đổi mới AI, điều khiển robotics đáng tin cậy, xử lý video hiệu quả về chi phí và tích hợp nâng cao cho NFT và các công cụ tự động. Được thành lập bởi Jermaine Anugwom, VentureMind AI đã nhanh chóng phát triển từ một tập hợp các công cụ AI chuyên biệt thành một nền tảng mạnh mẽ kết hợp công nghệ blockchain và tokenomics, định vị mình như một nhà lãnh đạo trong bối cảnh Web3 đang nổi lên.

4 tháng trước

Theta Hợp Tác Với Đại Học Quốc Gia Seoul Để Tăng Cường Nghiên Cứu AI

Theta đã công bố một quan hệ đối tác quan trọng với Đại học Quốc gia Seoul (SNU), cơ sở giáo dục hàng đầu của Hàn Quốc, nhằm tăng cường nghiên cứu AI thông qua nền tảng EdgeCloud của mình. Sự hợp tác này sẽ đặc biệt mang lại lợi ích cho Phòng thí nghiệm AIoT của SNU, do Phó Giáo sư Hyung-Sin Kim dẫn dắt, người nổi tiếng với chuyên môn về AI Môi trường và hệ thống IoT. Quan hệ đối tác nhằm tăng tốc nghiên cứu trong các lĩnh vực như đổi mới y tế được hỗ trợ bởi AI và xử lý dữ liệu thời gian thực, tận dụng tài nguyên GPU đám mây lai tiên tiến của Theta. SNU, được thành lập vào năm 1946, được công nhận vì sự xuất sắc trong nhiều lĩnh vực và luôn được xếp hạng trong số các trường đại học hàng đầu ở châu Á.

Kể từ khi ra mắt EdgeCloud vào tháng 6, Theta đã thu hút sự chú ý trong cả giới học thuật Mỹ và Hàn Quốc, hợp tác với một số cơ sở danh tiếng bao gồm Đại học Oregon và KAIST. Phòng thí nghiệm AIoT tại SNU đã có những đóng góp đáng chú ý cho lĩnh vực này, với Giáo sư Kim dẫn dắt các nỗ lực đã nhận được nhiều giải thưởng và các khoản tài trợ nghiên cứu có tác động cao. Những thành tựu gần đây bao gồm các giải thưởng tại các hội nghị và cuộc thi lớn, thể hiện cam kết của phòng thí nghiệm trong việc thúc đẩy công nghệ AI và IoT. Việc tích hợp cơ sở hạ tầng của Theta dự kiến sẽ nâng cao khả năng của phòng thí nghiệm trong việc phát triển các mô hình thích ứng ưu tiên quyền riêng tư dữ liệu và thông tin sức khỏe thời gian thực.

Giáo sư Kim bày tỏ sự hào hứng về sự hợp tác, nhấn mạnh cách mà cơ sở hạ tầng AI phi tập trung của Theta sẽ định nghĩa lại cảnh quan GPU và cho phép những tiến bộ đột phá trong các ứng dụng AI Môi trường và IoT. Quan hệ đối tác này không chỉ củng cố cam kết của Theta trong việc hỗ trợ nghiên cứu AI đẳng cấp thế giới mà còn định vị công ty như một nhân tố chính trong bối cảnh học thuật, với khát vọng thu hút thêm nhiều cơ sở hàng đầu ở châu Á và Bắc Mỹ. Khi Theta tiếp tục mở rộng ảnh hưởng của mình, sự hợp tác với SNU đánh dấu một bước quan trọng trong việc thúc đẩy các ứng dụng thực tiễn đổi mới trong các lĩnh vực AI và IoT.

Đăng ký để nhận tin tức và cập nhật mới nhất từ DePIN