최신 DePIN 클라우드 서비스 뉴스

3달 전

알레프 클라우드: AI 애플리케이션을 위한 분산형 슈퍼클라우드

인공지능(AI) 시스템이 주목받으면서 분산형, 안전하고 적응 가능한 인프라에 대한 수요가 점점 더 중요해지고 있습니다. 알레프 클라우드는 체인에 구애받지 않고 GDPR을 준수하는 슈퍼클라우드로, 분산 노드 네트워크를 통해 확장 가능한 저장소, 컴퓨팅 및 데이터베이스 서비스를 제공합니다. 이 플랫폼은 동적 IPFS 기반 저장소와 변경 가능한 데이터베이스, 안전한 컴퓨팅 자원을 통합하여 게임의 실시간 데이터 처리부터 대규모 AI 모델 배포에 이르기까지 다양한 애플리케이션에 대응합니다. 알레프 생태계에는 이 분산 인프라에서 애플리케이션 배포 및 관리를 간소화하는 TwentySix Cloud도 포함되어 있습니다.

알레프 클라우드는 신뢰할 수 있는 컴퓨팅 파워와 안전한 데이터에 지속적으로 접근해야 하는 AI 에이전트에게 특히 유익합니다. 이 플랫폼은 주문형 및 지속형 가상 머신(VM)과 분산 네트워크에서 작동하는 서버리스 기능을 포함한 확장 가능한 컴퓨팅 옵션을 제공합니다. 또한, 기밀 VM은 하드웨어 기반 암호화를 활용하여 민감한 계산의 프라이버시를 보장합니다. 2025년 1분기에 출시될 예정인 GPU 마켓플레이스는 AI 훈련 및 렌더링과 같은 고성능 작업을 가능하게 하여 플랫폼의 기능을 더욱 향상시킬 것입니다. 이 멀티 체인 지원은 AI 에이전트가 다양한 블록체인 생태계와 원활하게 상호작용할 수 있도록 하여 혁신적인 애플리케이션의 개발 및 배포를 촉진합니다.

Arweave, Filecoin 및 AWS와 같은 다른 클라우드 솔루션과 비교할 때, 알레프 클라우드는 프라이버시 우선 프레임워크에서 동적 저장소와 분산 컴퓨팅 자원을 결합하여 두드러집니다. 그 고유한 제공 사항에는 유연한 저장소 관리, 통합된 컴퓨팅 기능 및 기밀 VM을 통한 보안 강화가 포함됩니다. 또한, 알레프 클라우드의 경제 모델은 네이티브 ALEPH 토큰을 활용하여 네트워크 참여를 장려하고 신뢰할 수 있는 서비스를 보장합니다. 최대 100만 달러의 클라우드 크레딧을 제공하는 보조금 캠페인을 통해 알레프 클라우드는 개발자들이 프로젝트를 탐색하고 확장할 수 있도록 지원하며, 분산된 환경에서 AI 기반 애플리케이션을 위한 선도적인 솔루션으로 자리매김하고 있습니다.

3달 전

스트라토스, 볼틱스 AI와 협력하여 분산 컴퓨팅 혁신

스트라토스가 최첨단 분산 컴퓨팅 플랫폼인 볼틱스 AI와 흥미로운 파트너십을 발표했습니다. 이 파트너십은 AI 훈련, 고성능 컴퓨팅(HPC) 및 Web3 애플리케이션을 향상시키는 것을 목표로 하고 있습니다. AI 컴퓨팅 파워와 분산 데이터 저장소에 대한 수요가 급증함에 따라, 전통적인 클라우드 제공업체는 종종 비싸고 중앙집중화된 것으로 여겨지며, 이는 잠재적인 병목 현상을 초래할 수 있습니다. 이 협력은 개발자, 기업 및 Web3 애플리케이션을 지원하는 신뢰할 수 없는 분산 및 인센티브 기반 생태계를 제공함으로써 이러한 장벽을 허물고자 합니다.

볼틱스 AI는 유휴 CPU 파워를 활용하여 AI 및 HPC를 최적화하며, 스트라토스는 안전하고 고성능의 저장 솔루션을 제공하여 이를 보완합니다. 이 파트너십의 완전한 분산 특성은 중앙 실패 지점을 제거하여 사용자에게 확장성과 신뢰성을 보장합니다. 또한, 인센티브 생태계는 스트라토스가 트래픽 증명 메커니즘을 통해 저장 제공자에게 보상을 제공하고, 볼틱스 AI가 컴퓨팅 자원에 대한 기여를 장려하는 주요 특징입니다. 이 혁신적인 접근 방식은 성능을 향상시킬 뿐만 아니라 모든 참가자를 위한 협력 환경을 조성합니다.

더욱이, 스트라토스의 API는 원활한 비디오 스트리밍을 지원하여 AI 기반 콘텐츠에 대한 개인적이고 고품질의 스트리밍을 가능하게 합니다. 분산 저장소, 컴퓨팅 및 AI 작업을 통합함으로써, 스트라토스와 볼틱스 AI는 개발자와 기업이 전통적인 중앙집중화된 클라우드 제공업체에 의존하지 않고 독립적으로 운영할 수 있는 미래를 열어가고 있으며, 궁극적으로 더 효율적이고 회복력 있는 기술 환경으로 이어질 것입니다.

4달 전

탈중앙화 엣지 AI 플랫폼 Network3, $N3 토큰 거래 시작

탈중앙화 엣지 AI 인프라 플랫폼 Network3가 Bybit, Gate.io 및 BingX에서 $N3 토큰의 현물 거래를 시작합니다

공식 소식에 따르면, 탈중앙화 엣지 AI 인프라 플랫폼 Network3는 2025년 1월 22일 8:00 (UTC)에 Bybit, Gate.io 및 BingX 거래소에서 $N3 토큰의 현물 거래를 동시에 시작할 예정입니다. 이 이정표 이벤트는 사용자 엣지 데이터와 컴퓨팅 파워의 가치를 실현하기 위한 Network3의 중요한 단계를 의미하며, 생태계의 개발 및 확장에 강력한 동력을 주입합니다.

Network3는 현재 커뮤니티에 5천만 개의 토큰을 보상하는 Pre-TGE 에어드롭 활동을 진행 중입니다. 사용자는 공식 Network3 웹사이트에 로그인하고 지정된 작업을 완료하기만 하면 TGE 이후 $N3로 교환할 수 있는 40,000 포인트의 무료 에어드롭 할당량을 받을 수 있습니다. 또한, 이 활동은 사용자가 노드 채굴 효율성을 높일 수 있도록 돕는 NFT 가속 카드도 제공합니다.

2024년 7월 23일, Network3는 Borderless, EV3 Labs, loTeX, SNZ, Bing Ventures, Waterdrip Capital, Web3Port Foundation 및 기타 유명 벤처 캐피탈 기관을 포함한 투자자들과 함께 550만 달러의 프리 시드 및 시드 라운드 자금을 성공적으로 완료했습니다.

5달 전

아큐라스트의 앰배서더 프로그램에 참여하세요: 분산형 클라우드 기술의 미래를 형성하세요

아큐라스트는 분산형 물리적 인프라 네트워크(DePIN) 분야의 선구적인 프로젝트로, 50명의 앰배서더를 모집하여 그 범위를 확장하는 이니셔티브를 시작합니다. 이 움직임은 AI 시대를 위해 특별히 설계된 분산형 클라우드 기술을 향상시키는 것을 목표로 합니다. 이 프로그램은 클라우드 컴퓨팅의 미래를 재편하는 데 중점을 둔 Cloud Rebellion에 참여할 역동적인 개인을 초대합니다. 이 이니셔티브의 일환으로, 앰배서더는 아큐라스트의 사명을 홍보하고 전 세계 청중과 소통하는 중요한 역할을 하게 됩니다.

앰배서더는 콘텐츠 제작 및 지식과 창의성을 공유하기 위한 모임 조직 등 다양한 책임을 맡게 됩니다. 그들은 또한 소셜 미디어에서 아큐라스트의 존재감을 확대하고, 사용자와 소통하며, 커뮤니티 토론을 촉진하는 임무를 수행합니다. 이 역할은 앰배서더가 혁신적인 프로젝트를 대표할 수 있을 뿐만 아니라, 그들의 기여에 대해 cACU 토큰으로 보상을 받을 수 있는 기회를 제공합니다. 또한, 그들은 브랜드 상품 및 새로운 기능에 대한 조기 접근과 같은 독점적인 특전을 받게 되어, 그들의 참여가 보람 있고 흥미로운 경험이 됩니다.

아큐라스트는 분산화를 추진하고자 하는 열정적인 커뮤니티 빌더, 창의적인 마케터 및 기술 애호가를 찾고 있습니다. 이 프로그램은 분산형 기술의 잠재력에 대해 흥미를 느끼고 의미 있는 영향을 미치고자 하는 개인을 위해 설계되었습니다. 관심 있는 후보자는 지원하여 전 세계 사용자에게 권한을 부여하는 분산형 클라우드를 구축하는 데 참여할 것을 권장합니다. 이는 AI 시대의 클라우드 기술의 미래를 향한 중요한 발걸음입니다.

5달 전

io.net, 분산형 GPU 솔루션 강화를 위한 Dell Technologies 파트너 프로그램에 가입

io.net은 최근 GPU를 위한 분산형 물리적 인프라 네트워크(DePIN)의 주요 플레이어로서 Dell Technologies 파트너 프로그램에 가입했습니다. 이 전략적 제휴는 io.net의 비즈니스 개발, 판매 및 마케팅 노력을 강화하기 위해 설계되었습니다. 공인 파트너이자 클라우드 서비스 제공업체인 io.net은 Dell의 강력한 인프라와 분산형 GPU 네트워크를 통합하여 인공지능(AI), 머신러닝(ML), 고성능 컴퓨팅(HPC)과 같은 신기술에 맞춤화된 확장 가능하고 비용 효율적인 솔루션을 제공하는 것을 목표로 하고 있습니다. io.net의 비즈니스 개발 부사장인 Tausif Ahmed는 이 파트너십이 회사에 중요한 이정표가 되며 AI, ML 및 HPC 분야의 선도적인 솔루션 제공업체로 자리매김할 것이라고 강조했습니다.

Dell Technologies 파트너 프로그램은 파트너에게 필수적인 비즈니스 개발, 판매 및 마케팅 자원을 제공하는 국제적인 이니셔티브입니다. 이 프로그램에 가입함으로써 io.net은 분산형 GPU 네트워크의 확장을 촉진하고 시장 역량을 강화하는 데 도움이 되는 풍부한 자원에 접근할 수 있게 됩니다. 이 협업은 io.net이 다른 파트너와 전략을 세울 수 있을 뿐만 아니라 글로벌 범위를 확장하여 분산형 GPU 파워를 Dell의 신뢰할 수 있는 하드웨어 인프라와 원활하게 통합하는 솔루션을 배포할 수 있게 합니다. 이 파트너십은 io.net의 시장 진출 노력과 공동 마케팅 활동을 강화할 것으로 예상되며, 궁극적으로 고급 컴퓨팅 솔루션을 찾는 기업 고객에게 혜택을 줄 것입니다.

AI 및 ML 산업에서 확장 가능하고 효율적인 컴퓨팅 서비스에 대한 수요가 계속 증가함에 따라, io.net의 분산형 네트워크는 전통적인 클라우드 서비스 제공업체에 대한 매력적인 대안을 제공합니다. 신속하게 배포할 수 있고 비용이 낮은 온디맨드 GPU 클러스터를 제공함으로써 io.net은 AI 개발에서 조직이 직면한 병목 현상을 해결합니다. Dell과의 파트너십은 AI 교육, 추론 및 HPC 사용 사례에 참여하는 기업을 위해 분산형 컴퓨팅 솔루션에 대한 접근을 민주화할 것으로 기대됩니다. Dell의 글로벌 존재감과 신뢰받는 명성을 바탕으로 io.net은 다양한 산업에서 이러한 혁신적인 솔루션의 채택을 가속화할 수 있는 좋은 위치에 있습니다.

5달 전

아큐라스트, iOS용 프로세서 라이트 출시 - 사용자에게 컴퓨팅 파워 공유 권한 부여

아큐라스트는 최근 분산형 기밀 클라우드 컴퓨팅의 선두주자로서 iOS용 아큐라스트 프로세서 라이트를 출시하였으며, 이제 애플 앱 스토어에서 이용할 수 있습니다. 이 혁신적인 애플리케이션은 아이폰 사용자가 자신의 기기의 컴퓨팅 파워를 아큐라스트의 분산형 클라우드 네트워크와 공유할 수 있도록 하여 cACU 토큰 형태로 보상을 받을 수 있는 기회를 제공합니다. 모바일 기기에서 발견되는 고급 프로세서를 활용함으로써 아큐라스트는 일반 스마트폰이 강력한 컴퓨팅 제공자로 기능할 수 있도록 하여 생태계를 크게 확장하고 아이폰 사용자가 클라우드 컴퓨팅에 대한 혁신적인 접근 방식에 참여하도록 초대합니다.

아큐라스트 프로세서 라이트는 접근성을 향상시킬 뿐만 아니라 오래되거나 손상된 모바일 전화를 저렴한 컴퓨팅 자원으로 재활용함으로써 지속 가능성을 촉진합니다. 이 이니셔티브는 전통적인 서버에 대한 비용 효율적인 대안을 제공하며, 클라우드 인프라의 핵심에 지속 가능성을 통합합니다. 사용자는 인터넷에 연결된 프로세서를 실행하기만 하면 한 달에 최대 250 cACU 토큰을 얻을 수 있으며, 개발자가 사용자의 처리 자원을 사용하여 아큐라스트 클라우드에 애플리케이션을 배포할 때 추가 보상을 받을 수 있습니다. 이 모델은 참여를 장려하고 분산형 클라우드 환경에 기여하는 사용자에게 보상을 제공합니다.

아큐라스트의 공동 창립자인 알레산드로 데 카를리는 이 출시가 클라우드 컴퓨팅의 민주화에 있어 중요하다고 강조했습니다. 그는 아이폰 사용자가 자신의 기기의 컴퓨팅 파워를 기여할 수 있도록 함으로써 아큐라스트가 보다 분산되고 안전하며 기밀한 클라우드 인프라를 조성하고 있다고 말했습니다. 이 이니셔티브는 기술 발전에만 집중하는 것이 아니라 개인이 컴퓨팅 자원의 활용 방식을 재정의하는 글로벌 운동에 참여할 수 있도록 권한을 부여합니다. 사용자는 프로세서 라이트 앱을 다운로드하여 아큐라스트 클라우드 반란에 참여할 수 있으며, 이는 보다 사용자 주도적이고 지속 가능한 클라우드 컴퓨팅 환경으로의 전환을 지원합니다.

5달 전

아필론, Web3 개발자를 위한 분산형 클라우드 함수 서비스 출시

아필론은 Acurast와 협력하여 Web3 개발자를 위한 클라우드 함수 서비스 출시를 발표했습니다. 이 분산형 서버리스 인프라는 성능을 향상시키고 비용을 절감하며 보안을 해치지 않으면서 최대의 유연성을 제공하도록 설계되었습니다. 아필론의 새로운 서비스를 활용함으로써 개발자들은 다운타임에 대한 두려움 없이 중요한 작업에 집중할 수 있으며, 이는 Web3의 핵심 가치와 완벽하게 일치합니다. 이 이니셔티브는 많은 분산 애플리케이션(dapp)이 전통적인 중앙 집중형 클라우드 공급자에 의존하는 지속적인 문제를 해결합니다. 이러한 중앙 집중형 공급자는 단일 실패 지점 및 투명성 부족과 같은 위험을 초래합니다.

아필론과 Acurast 간의 파트너십은 분산형 솔루션과 중앙 집중형 솔루션이 제공하는 강력함 사이의 격차를 해소하고자 합니다. 아필론은 개발자들이 JavaScript, TypeScript 및 Node.js 코드를 지원하여 클라우드 함수를 원활하게 배포할 수 있도록 합니다. 이 플랫폼은 효율적인 배포 및 관리를 위한 API, SDK 및 CLI 도구를 갖추고 있습니다. 각 배포는 맞춤형 HTTPS 게이트웨이를 생성하여 Web2 개발자에게 친숙한 HTTP POST 요청을 가능하게 합니다. 또한, Acurast의 기밀 컴퓨팅 기능 통합은 민감한 작업에 대한 비할 데 없는 보안과 프라이버시를 보장하여 데이터 무결성을 유지하면서 혁신을 촉진합니다.

아필론의 클라우드 함수 서비스의 이점은 단순한 기능을 넘어섭니다. 이 서비스는 dapp 수요에 따라 자동으로 조정되는 확장성을 제공하며, 사용량 기반 요금제를 통해 비용 효율성을 제공합니다. 이 서비스는 Web3를 위해 특별히 구축되어 스마트 계약 및 오프체인 데이터와의 원활한 상호작용을 가능하게 합니다. 신뢰성과 분산 환경의 약속과 함께 아필론과 Acurast는 전통적인 인프라의 제약 없이 Web3 애플리케이션이 번창할 수 있는 미래를 열어가고 있으며, 개발자들이 혁신과 창의성에 집중할 수 있도록 지원하고 있습니다.

5달 전

아카시 네트워크: 분산 물리 인프라의 선두주자

2024년, 암호화폐 환경은 분산 물리 인프라 네트워크(DePIN)의 트렌드에 의해 지배되고 있으며, 아카시 네트워크는 이 분야에서 중요한 플레이어로 부상하고 있습니다. 저명한 소프트웨어 개발자이자 앤젤핵의 창립자인 그렉 오수리가 공동 창립한 아카시는 컴퓨팅 자원의 구매 및 판매를 촉진하는 오픈 소스 "슈퍼 클라우드"로 운영됩니다. 이 모델은 현재 인공지능 시대에 특히 관련성이 높으며, 컴퓨팅 파워에 대한 수요가 급증하고 있습니다. DePIN은 블록체인 기술을 활용하여 일반적으로 분산되어 있는 자원에 대한 접근을 간소화하며, 아카시는 Nvidia의 칩과 같은 중앙 집중식 컴퓨팅 솔루션에 대한 실질적인 대안으로 자리 잡고 있습니다.

아카시 네트워크는 개인 사용자에게 더 저렴한 컴퓨팅 파워에 대한 접근을 민주화하는 것을 목표로 하고 있습니다. 오수리는 플랫폼의 핵심 가치를 강조하며, 아카시가 사용자에게 "계산할 권리"를 제공하여 검열로부터의 자유를 촉진하고 자유로운 사고를 장려한다고 말합니다. 아카시 네트워크의 네이티브 토큰인 $AKT는 이 생태계 내에서 거래의 통화 역할을 하여 블록체인 기술을 일상적인 컴퓨팅 요구에 더욱 통합합니다. 이러한 혁신적인 접근 방식은 사용자들 사이에서 상당한 관심과 사용을 끌어모았습니다.

아카시는 그 성장하는 인기를 놀라운 방식으로 입증하며, 2024년 3분기 사용자 수수료가 전년 대비 1,729% 증가했다고 보고했습니다. 이 급증은 분산 컴퓨팅 솔루션에 대한 강한 수요를 나타내며, 아카시가 클라우드 컴퓨팅의 미래를 재편할 잠재력을 강조합니다. DePIN이 계속 발전함에 따라, 아카시 네트워크는 모든 사용자에게 컴퓨팅 자원을 접근 가능하고 저렴하게 만드는 선구적인 힘으로 두드러지고 있으며, 암호화폐 공간의 광범위한 트렌드와 일치하고 있습니다.

6달 전

4EVERLAND: 이중 토큰 모델로 Web3 클라우드 컴퓨팅을 선도하다

4EVERLAND는 저장, 네트워킹 및 컴퓨팅 기능을 통합한 클라우드 컴퓨팅 플랫폼으로 Web3 환경을 혁신하고 있습니다. 분산 물리적 인프라 네트워크(DePIN) 및 AI 분야에 위치한 4EVERLAND는 개발자들이 Web2에서 Web3로 원활하게 전환할 수 있도록 돕는 것을 목표로 하고 있습니다. 플랫폼의 경제 모델은 네트워크 안정성과 보안을 보장하면서 지속 가능한 인센티브 메커니즘을 촉진하도록 세심하게 설계되었습니다. 이러한 접근 방식은 회복력 있는 인프라의 배치를 가속화할 뿐만 아니라 모든 이해관계자 간의 공정한 혜택 분배를 보장하여 생태계의 전반적인 가치를 향상시키는 공동 목표를 향한 협력을 촉진합니다.

4EVERLAND의 이중 토큰 경제 모델은 거버넌스 토큰인 $4EVER와 자원 회계 토큰인 $LAND로 구성됩니다. $LAND는 고정 환율에 고정된 안정적인 결제 시스템으로, 자원 소비에 대한 예측 가능한 청구를 보장합니다. 이는 생태계 내에서 자원 결제에만 사용되며, 2차 시장에서 거래될 수 없습니다. 반대로, $4EVER는 거버넌스 및 유틸리티 토큰으로 기능하며, 보유자들이 의사 결정 과정에 참여하고 자산 매입 메커니즘을 통해 가치를 포착할 수 있도록 합니다. 이 이중 구조는 자원 소비와 거버넌스를 효과적으로 분리하여 사용자 참여와 유동성을 향상시키는 간소화된 운영 모델을 제공합니다.

앞으로 4EVERLAND의 토큰 경제는 장기적인 안정성과 성장 기회를 균형 있게 유지하도록 설계되었습니다. 총 공급량이 100억 개의 $4EVER 토큰인 이 모델은 자원 제공자를 유인하고 커뮤니티 개발을 지원하며 운영 자금을 보장하기 위해 전략적으로 배분됩니다. 플랫폼의 비전은 $4EVER를 분산 인터넷의 핵심 구성 요소로 확립하여 개발자와 사용자가 협력하여 번창하는 Web3 생태계를 구축할 수 있도록 하는 것입니다. 4EVERLAND가 계속 발전함에 따라 분산 인프라 및 커뮤니티 주도 혁신의 미래에서 중요한 플레이어가 될 준비가 되어 있습니다.

6달 전

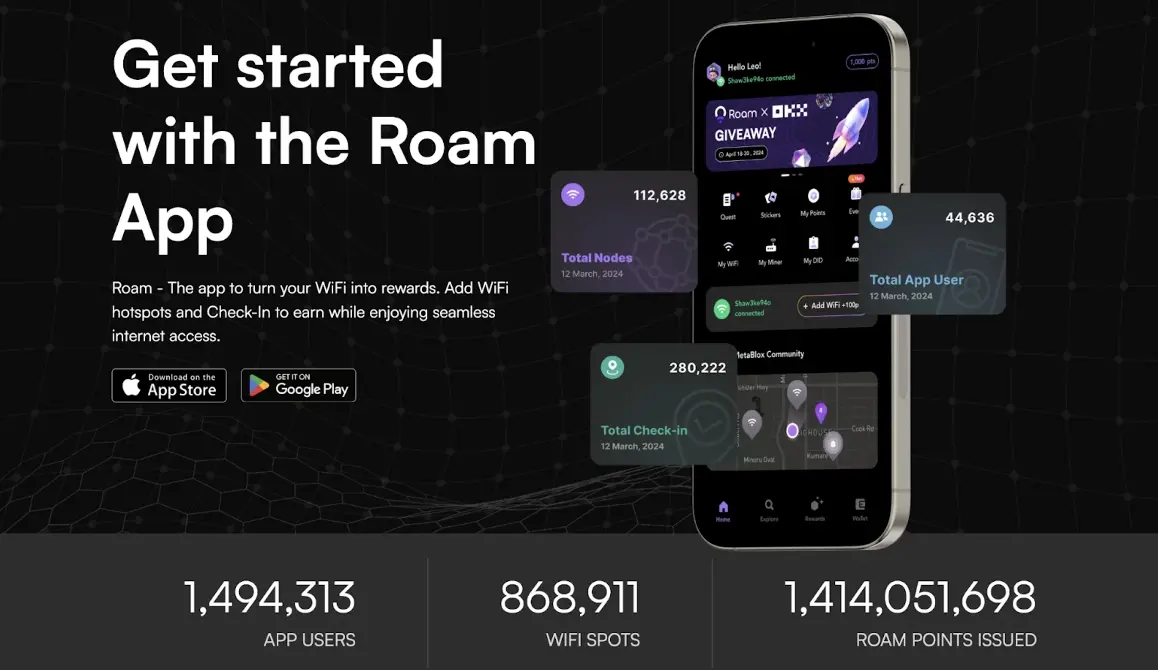

로암: 디지털 노마드를 위한 원활한 연결성 제공

팬데믹 이후의 세계에서 디지털 노마드의 증가가 특히 원격 근무자들 사이에서 점점 더 두드러지고 있습니다. 이 라이프스타일은 개인이 전문적인 의무를 유지하면서 자유롭게 여행할 수 있게 해주며, 아루바와 카보베르데와 같은 장소가 인기 있는 선택지가 되고 있습니다. 이러한 노마드들에게 신뢰할 수 있는 인터넷 연결의 수요는 매우 중요하며, 로암 네트워크는 주요 솔루션으로 떠오르고 있습니다. 로암은 전 세계 무선 네트워크를 제공함으로써 사용자가 위치에 관계없이 원활한 연결성을 촉진하고, 디지털 노마드 경험을 향상시키는 것을 목표로 하고 있습니다.

전통적인 공공 WiFi 네트워크와 관련된 문제, 예를 들어 번거로운 로그인 과정과 보안 취약점은 OpenRoaming™ 기술 개발을 촉발했습니다. 이 이니셔티브는 무선 광대역 동맹에 의해 주도되며, 안전하고 사용자 친화적인 WiFi 경험을 창출하는 것을 목표로 하고 있습니다. OpenRoaming™은 사용자가 반복적인 인증 없이 다양한 WiFi 네트워크에 연결할 수 있도록 하여 암호화된 데이터 전송을 보장합니다. 현재 400만 개 이상의 OpenRoaming™ 노드가 증가하고 있지만, 여전히 전 세계 공공 WiFi 환경의 작은 부분을 차지하고 있어 성장 가능성이 큽니다.

로암은 OpenRoaming™ 동맹 내에서 Web3 IDP 프로젝트로 독특한 위치를 차지하고 있으며, 분산된 신원 기술을 통합하여 사용자와 소기업의 네트워크 접근성을 향상시키고 있습니다. Rainier MAX60 라우터와 로암 eSIM과 같은 혁신적인 솔루션을 통해 플랫폼은 150만 명 이상의 사용자 기반을 빠르게 확장하고 있습니다. 로암의 커뮤니티 중심 접근 방식과 로암 포인트 및 거버넌스 토큰을 포함한 다양한 인센티브 모델은 사용자 참여를 촉진하고 OpenRoaming™ 네트워크의 성장을 지원하도록 설계되었습니다. 로암이 Web2와 Web3 기술을 연결하는 작업을 계속하면서, 전 세계 디지털 노마드를 위한 통신 환경을 변화시키고 연결성을 향상시키는 중요한 역할을 할 것으로 기대됩니다.

최신 DePIN 뉴스와 업데이트를 위해 가입하세요