Theta EdgeCloud lance des clusters GPU pour un entraînement amélioré des modèles d'IA

Theta EdgeCloud a introduit une amélioration significative en permettant aux utilisateurs de lancer des clusters GPU, essentiels pour l’entraînement de grands modèles d’IA. Cette nouvelle fonctionnalité permet la création de clusters composés de plusieurs nœuds GPU du même type au sein d’une région spécifique, facilitant la communication directe entre les nœuds avec une latence minimale. Cette capacité est cruciale pour l’entraînement distribué des modèles d’IA, car elle permet un traitement parallèle entre les appareils. Par conséquent, les tâches qui nécessitaient traditionnellement des jours ou des semaines à accomplir sur un seul GPU peuvent désormais être réalisées en quelques heures, voire en quelques minutes, accélérant ainsi considérablement le cycle de développement des applications d’IA.

L’introduction des clusters GPU améliore non seulement l’efficacité de l’entraînement, mais prend également en charge l’évolutivité horizontale, permettant aux utilisateurs d’ajouter dynamiquement plus de GPU selon les besoins. Cette flexibilité est particulièrement bénéfique pour l’entraînement de grands modèles de base ou d’architectures à plusieurs milliards de paramètres qui dépassent la capacité mémoire d’un seul GPU. La demande pour cette fonctionnalité a été exprimée par de nombreux clients d’EdgeCloud, y compris des institutions de recherche en IA de premier plan, soulignant son importance dans l’évolution continue de Theta EdgeCloud en tant que plateforme cloud décentralisée de premier plan pour l’IA, les médias et le divertissement.

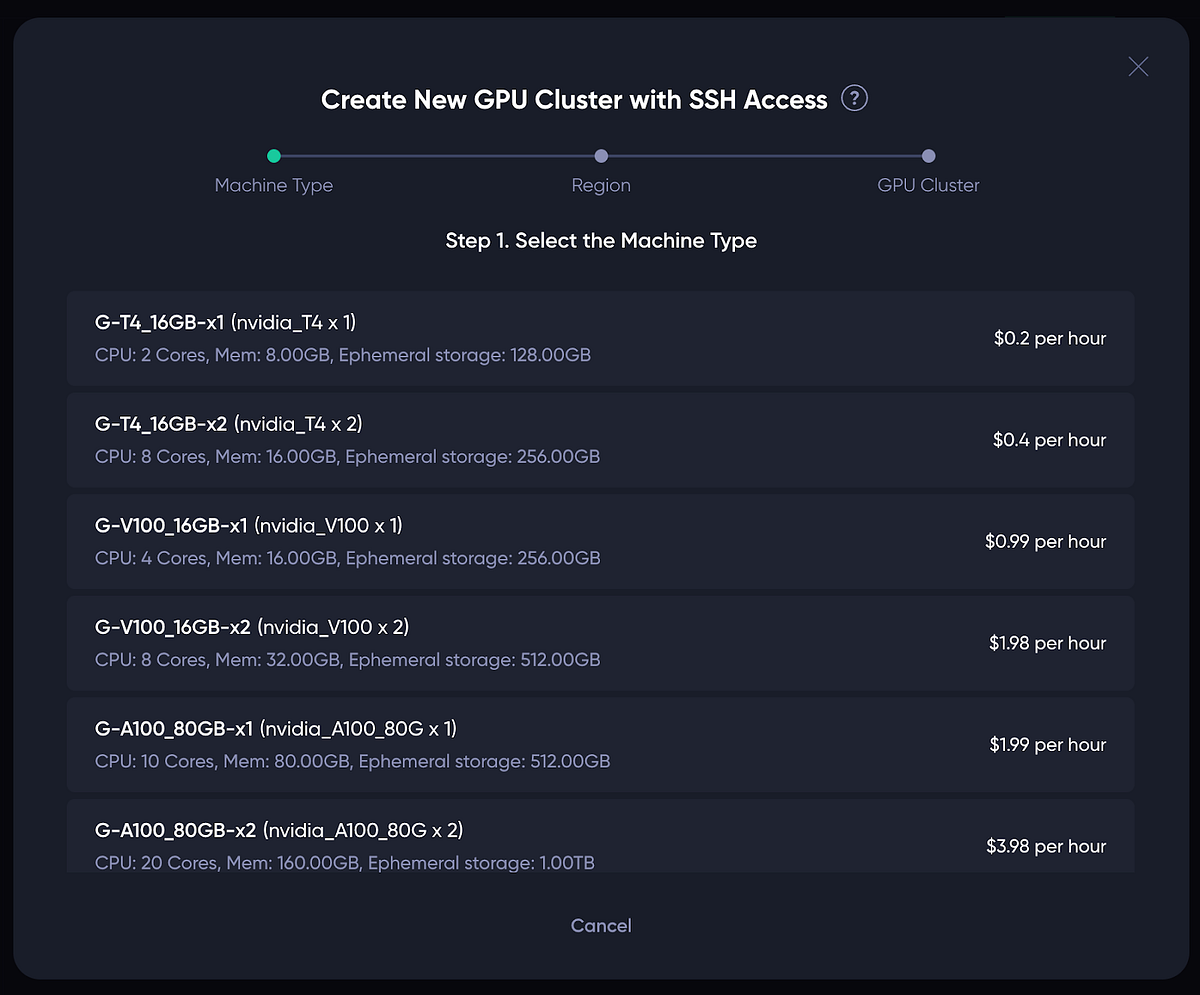

Pour commencer avec les clusters GPU sur Theta EdgeCloud, les utilisateurs peuvent suivre un processus simple en trois étapes. Cela inclut la sélection du type de machine, le choix de la région et la configuration des paramètres du cluster tels que la taille et l’image du conteneur. Une fois le cluster créé, les utilisateurs peuvent se connecter par SSH aux nœuds GPU, leur permettant d’exécuter efficacement des tâches distribuées. De plus, la plateforme permet une mise à l’échelle en temps réel du cluster GPU, garantissant que les utilisateurs peuvent s’adapter aux charges de travail changeantes sans problème. Dans l’ensemble, cette nouvelle fonctionnalité positionne Theta EdgeCloud comme un acteur compétitif dans l’espace cloud décentralisé, en particulier pour les applications axées sur l’IA.

Related News